Codex AI 编程工具测评:多环境支持、模型对比与自动化 PR 工作流

核心结论

Codex 的核心优势在于全环境覆盖(CLI / IDE 插件 / 云端 / SDK)和强大的上下文管理能力。配合 GPT-5 模型,编程表现处于行业顶尖水平。但使用第三方模型时存在兼容性问题,配置门槛也不算低。

模型编程效果对比

| 模型 | 评分 | 备注 |

|---|---|---|

| GPT-5 | 97 | 表现最优,持平 Cloud Code |

| GPT-5 Codex | 95 | 编程专用模型,略逊于通用 GPT-5 |

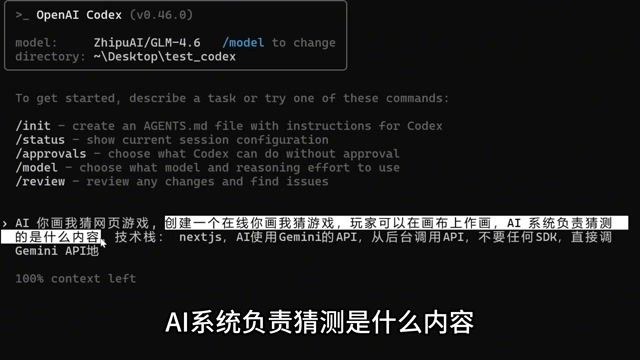

| GLM 4.6 | 80 | 存在黑屏 Bug,需优化 |

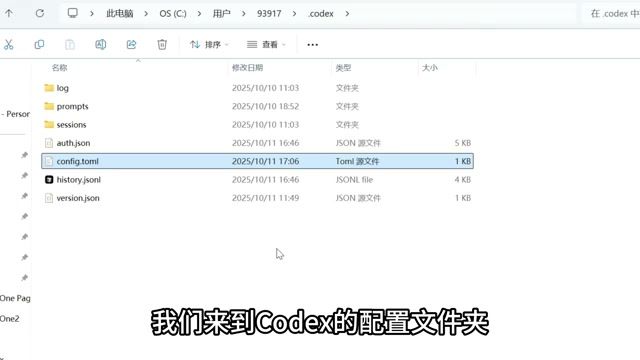

配置上手

Codex 通过 config.toml 文件管理核心配置,包括模型选择、API Key、环境变量等。对熟悉命令行的开发者来说流程清晰,但 Windows 下配置 MCP 工具和环境变量比较繁琐。

关键的 init 命令会扫描项目结构并生成 agents.md 文件,让 AI 深度理解项目上下文。这一步对后续编程效果影响很大。

编程效果

GPT-5 模型下的编程输出质量非常高,复杂任务的代码生成准确且结构清晰。

使用第三方或国产免费模型时,Codex 倾向于用 Shell 工具修改代码而非 ApplyPatch,容易引发错误。复杂任务下的表现与官方模型有明显差距。

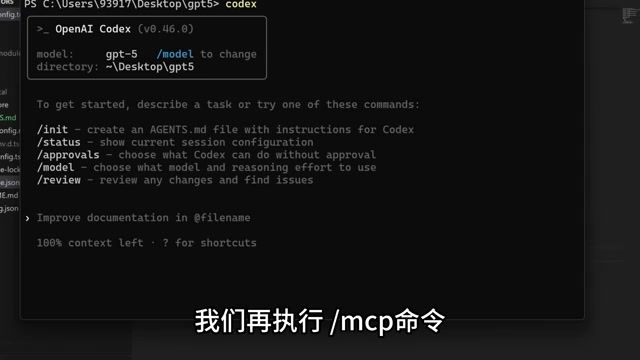

MCP 工具扩展

通过 MCP 协议可以扩展 Codex 的功能边界 — 连接数据库、调用外部 API、操作文件系统等。

配置过程涉及 JSON 格式的工具定义文件,新手容易在格式细节上出错。

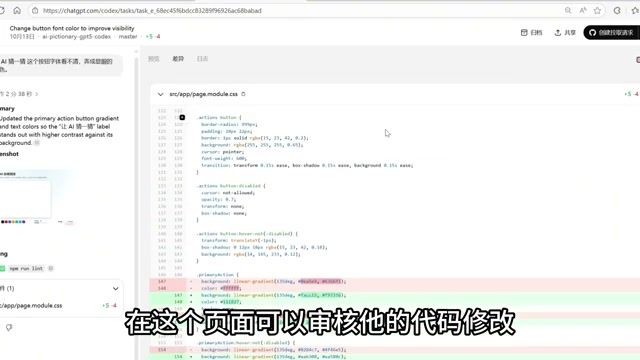

云端自动化 PR

Codex 最强的工作流是云端运行环境配合 GitHub:从理解需求、修改代码到自动创建 Pull Request,全流程无需手动操作。

对于团队协作场景,这意味着从代码修改到 Code Review 的流程可以大幅自动化,减少上下文切换开销。

需要注意的问题

第三方模型兼容性差。 接入国产免费模型时 Bug 较多,生产环境建议还是用官方模型。

Windows 配置麻烦。 环境变量、MCP 配置文件的格式在 Windows 下容易出问题,macOS/Linux 体验更顺畅。

有学习成本。 需要理解 config.toml 配置、init 命令、agents.md 的作用,完全不熟悉命令行的人上手会比较吃力。

适合什么人

处理复杂项目的专业开发者,使用 GitHub 协作并希望自动化 Code Review 流程的团队,以及需要跨设备跨环境开发的用户。轻度脚本编写或不愿学习新工具链的开发者可以暂时跳过。

延伸阅读:想了解 AI 如何管理项目上下文和记忆,参考 Claude Code 自动记忆系统详解;对国产大模型的编程能力感兴趣,可以看 千问 3.5 实测。